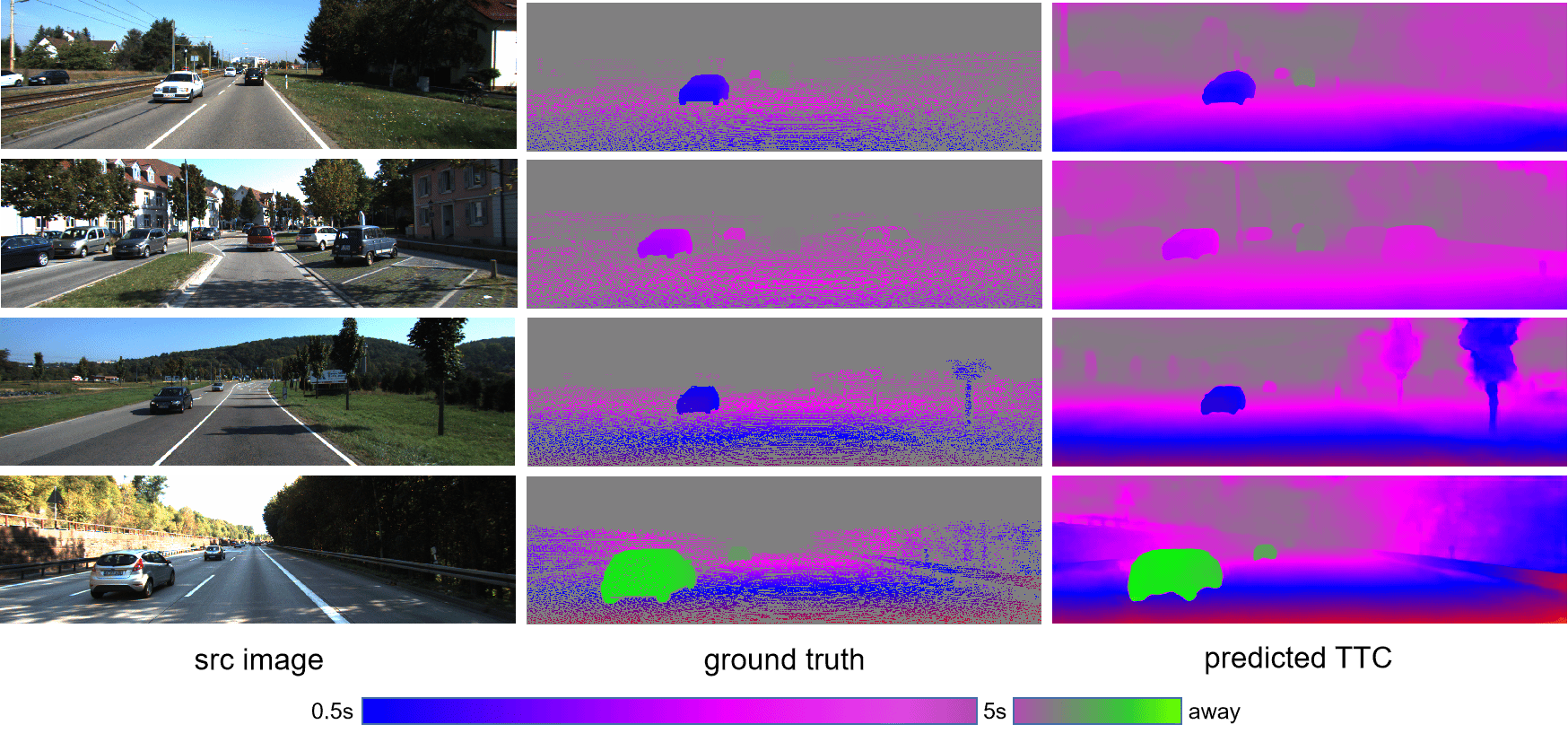

碰撞时间(Time-to-Collision, TTC) 是衡量目标距离观测平面发生碰撞所需时间的重要指标,在障碍物规避及其他下游模块中具有关键作用。以往研究多采用基于单目摄像头的端到端深度神经网络来估计TTC,虽在精度方面达到了当前最优水平(SOTA),但由于模型层次较深、参数众多,往往存在推理时间长、计算开销大的问题。此外,现有方法通常依赖于当前帧和未来帧两帧图像作为输入来计算TTC,这导致了实际推理中出现延迟。

为解决上述问题,本文提出了一种新型快速TTC预测模型:FP-TTC。该模型首先引入了一种基于注意力机制的尺度编码器,用于模拟图像间的尺度匹配过程,从而显著降低了计算成本并提升了预测精度。同时,在模型中引入了一项简单但高效的技巧:构建时间序列解码器,仅通过历史RGB图像预测当前时刻的TTC,避免了因系统时间步延迟带来的计算滞后,进一步提升了预测速度。与现有SOTA方法相比,FP-TTC模型在参数量上减少了89.1%,推理速度提升了6倍,预测精度提高了19.3%,在效率与性能之间实现了良好的平衡。

代码:https://github.com/LChanglin/FP-TTC